复杂网络动力学机器学习自动建模( 三 )

文章插图

文章插图

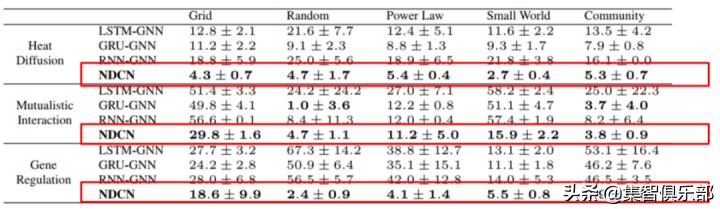

通过对上表的观察 , 我们会发现NDCN模型无论对标哪一种图网络结合循环神经网络的模型 , 都能够获得最有效果 。 此外 , 尤其值得一提的一点是 , 在这里的对比模型应用的参数量都是很多的(105数量级) , 而NDCN所用到的参数数量相比而言却少了两个数量级(103数量级) 。 这说明NDCN在使用较少的参数的情况下 , 达到了最优的效果 。

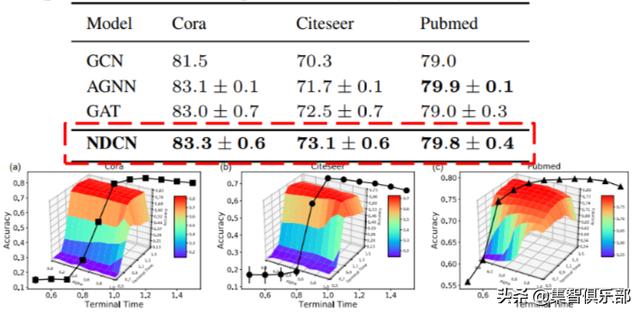

最后 , 让我们来分享一个半监督分类的有趣实验 。 这个实验与其他实验的不同之处在于 , 在半监督分类的任务中 , 并不存在一个“显式”的动力学过程 。 在这个任务中 , 我们可以获得的信息有图结构 , 节点上的特征信息和一部分节点的标签信息 , 我们的目的是给未标签的节点打上标签 。 为了解决这种没有“显式”动力学的问题 , 本文将标签信息和节点信息共同作为新的节点信息输入给NDCN模型 , 让模型通过学习信息的扩散来将标签扩散到整个网络上 。 在这个实验中 , 对比模型部分本文选取了GCN、GAT等经典模型 , 它们都十分擅长通过网络结构聚合节点信息 。 文章插图

文章插图

可以看到 , 在相同的训练次数下 , NDCN模型再一次在准确率上取得了最优结果 , 我们可以这样解释这个结果 , NDCN本身在连续的模型上运作 , 这允许我们以一种更精细的方式来建模动力学过程 。 在这个任务中 , 我们不需要特别深的网络结构来完成节点间的信息扩散 , 事实上 , 我们在T=1.2时达到了最优的效果(如果用传统的图网络语言来说 , 是在1.2层得到了最优的分类结果) , 而普通的图网络方法中 , 不存在“小数层”这一概念 , 由此 , 借用NDCN的方法 , 我们得以对动力学进行如此精细的控制 。

总 结本文提出了NDCN的框架 , 这个框架作为一个连续时间的图网络框架 , 结合了图网络和神经微分方程的优势 , 可以在连续时间预测、离散时间预测甚至半监督分类的任务中 , 都取得最优的结果 。 此外 , 值得注意的一点是NDCN模型是非常节省参数的 , 在大量的实验中 , NDCN所用的参数数量都会比对比模型少约两个数量级 。 在NDCN的框架下 , 我们得以进一步建模和学习复杂系统的动力学变化 , 为我们以数据驱动的方式建模和理解系统提供了一个有效的新思路 。

讲者:臧承熙

整理:张章

编辑:邓一雪

- 闲鱼|电诉宝:“闲鱼”网络欺诈成用户投诉热点 Q3获“不建议下单”评级

- 峰会|这场峰会厉害了!政府企业专家媒体共议网络内容生态治理

- 网络覆盖|爱立信:2020年底,将有超过10亿人口获得5G网络覆盖

- 星期一|亚马逊:黑五与网络星期一期间 第三方卖家销售额达到48亿美元

- 机器人|网络里面的假消息忽悠了非常多的小喷子和小机器人

- iphone12|菜鸟网络原副总裁被捕!此前多名高管被判刑

- 副局长|杨林副局长在美团总部调研网络食品安全监管工作

- 娟子|直播中贬损他人,“青海娟子”等4名网络主播被处罚

- 同比|今年前10个月,上海商品类网络购物交易额5520.2亿元,同比增长12.9%!

- 低俗|网络上还有多少马保国式闹剧