通过对抗数据扩增泛化到未知域

摘 要我们关注的学习模型可以很好地推广到不同的未知领域 。 我们考虑了最坏情况下在特征空间中源域附近的数据分布 。 仅使用单个源分布的训练数据 , 我们通过在当前模型下“困难”的虚拟目标域中的示例提出了一个增加数据集的迭代过程 。 我们证明了我们的迭代方案是一种自适应的数据扩充方法 , 其中我们会在每次迭代后附加对抗性示例 。 对于 softmax 的损失 , 我们证明了我们的方案是一种域数据相关的正则化方案 , 其行为与正则化为零的经典正则化器(例如 ridge 或 lasso)不同 。 在数字识别与语义分割的任务上 , 我们的方法学习模型改进一系列先验未知目标域的性能 。

1. 引言在许多机器学习的现代应用中 , 我们希望学习一种能够在多个人群中均匀表现的系统 。 但由于数据采集成本高 , 所以数据集中的人口来源通常有限 。 在对数据集进行验证评估时表现良好的

标准模型 , 通常是从相同人群中的训练集中收集的 , 所以一般对不同于训练数据集的人群表现不佳[15,3,1,32,38] 。 在本文中 , 我们关注的是在我们无法访问来自未知目标分布的任何数据的环境中 , 对不同于训练分布的人群进行推广 。 例如 , 考虑一个自动驾驶汽车的模块 , 需要在整个天气条件和培训期间未开发的城市环境中进行泛化 。

许多作者在设置中提出了自适应领域的方法(例如 , 见[9,39,36,26,40]) , 其中可以获得完全标记的源数据集和来自固定目标分布的未标记(或部分标记)的一组示例数据集 。 虽然这样的算法可以成功的学习在已知目标分布上表现良好的模型 , 但是在实际场景中先验固定目标分布的假设可能是限制性的 。 例如 , 考虑机器人使用的语义分割算法:每个任务、机器人、环境和摄像机的配置将产生不同的目标分布 , 并且只有在训练和部署模型之后才能识别这些不同的场景 , 这使得从它们收集样本变得困难 。

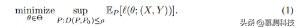

在这项工作中 , 我们开发的方法可以更好地学习推广到新的未知领域 。 我们考虑了限制性设置 , 其中训练数据仅来自单个源领域 。 受到分布式强大优化和对抗性训练的最新发展的启发[34,20,12] , 我们考虑围绕源分布(训练)P0 的以下最坏情况问题 。 文章插图

文章插图 文章插图

文章插图

最坏情况问题的解决方案(1)保证了针对远离源域 P0 的距离 ρ 的数据分布的良好性能 。为了允许对源 P0 具有不同支持的数据分布 , 我们使用 Wasserstein 距离作为我们的度量 D 。 我们的距离将在语义空间 3 上定义 , 因此满足 D(P , P0)小于等于 ρ 的目标群体 P 代表真实的协变量 保留源的相同语义表示的移位(例如 , 向灰度图像添加颜色) 。在这方面 , 我们期望解决最坏情况问题(1) - 我们希望学习的模型在语义空间中的协变量变化中具有良好的性能 。

我们提出了一个迭代过程 , 旨在解决问题(1)一次得到一个小的 ρ 值 , 并对模型 θ 进行关于这些虚构的最坏情况目标分布的随机梯度更新(第 2 节) 。我们方法的每次迭代都使用小的 ρ 值 , 我们提供了许多方法的理论解释 。首先 , 我们证明了我们的迭代算法是一种自适应数据扩增方法 , 我们在当前模型中将对侧扰动样本添加到数据集(第 3 节) 。更准确地说 , 我们的对手生成的样本大致对应于 Tikhonov 正则化 Newton-steps 关于语义空间中的损失 。此外 , 我们表明 , 对于 softmax 损失 , 我们方法的每次迭代都可以被认为是一种依赖于数据的正则化方案 , 其中我们向与真实标签相对应的参数向量进行正则化 , 而不是像经典正则化器那样向零正则化 , 例如 ridge 或者 lasso 。

从实际的角度来看 , 应用最坏情况公式(1)的关键难点在于协变量偏移 ρ 的大小是先验未知的 。我们提出学习一组对应于不同距离 ρ 的模型 。换句话说 , 我们的迭代方法生成一组数据集 , 每个数据集对应一个不同的数据集间距离水平 ρ , 我们为每个数据集学习一个模型 。在测试时 , 我们使用启发式方法从集合中选择合适的模型 。

我们在简单的数字识别任务上测试我们的方法 , 并在不同的季节和天气条件下测试更现实的语义分割任务 。在这两种设置中 , 我们观察到我们的方法允许学习能够改善与原始源域具有不同距离的先验未知目标分布的性能的模型 。

相关工作关于对抗性训练的文献[10,34,20,12]与我们的工作密切相关 , 因为主要目标是设计训练程序 , 学习对输入波动具有鲁棒性的模型 。 与对抗性训练中考虑的难以察觉的攻击不同 , 我们的目标是学习抵抗较大扰动的模型 , 即分布式样本 。 Sinha 等[34]提出了一种原则性的对抗性训练程序 , 其中生成最大化某些风险的新图像 , 并且针对那些对抗性图像优化模型参数 。 设计用于防御难以察觉的对抗性攻击 , 新的图像是在损失的情况下学习的 , 这种损失会惩罚原始图像和新图像之间的差异 。 在这项工作中 , 我们依赖于类似于 Sinha 等人提出的极小极大游戏 。在[34]中 , 是我们在语义空间中强加了约束 , 以便允许来自虚拟分布的对抗样本在像素级别上不同 , 同时共享相同的语义 。

- 查询|数据太多容易搞混?掌握这几个Excel小技巧,办公思路更清晰

- 黑莓(BB.US)盘前涨逾32%,将与亚马逊开发智能汽车数据平台|美股异动 | US

- 健身房|乐刻韩伟:产业互联网中只做单环节很难让数据发挥大作用

- V2X|V2X:确保未来道路交通数据交换的安全性

- 短视频平台|大数据佐证,抖音带动三千万就业,视频手机将成生产力工具?

- 权属|从数据悖论到权属确认,数据共享进路所在

- 统计|多久才能换一次手机?统计机构数据有点意外

- 发展|大数据解读世界互联网大会·互联网发展论坛!

- 网购|黑色星期五及网购星期一大数据出炉 全球第三方卖家销售额超48亿美元

- Veeam|Veeam让企业数据拥有“第二次生命”