化身|AI化身诊断胃癌小能手,模型敏感性高达近100%( 二 )

在之后的训练过程中,被标注为“恶性”的区域将被认为是高度上皮瘤变和胃癌病灶,这两种病变均需进行手术治疗;被标注为“图像质量低”和“可忽略”的区域将被认为是人体扫描质量低和难以诊断的部位。

3、模型采用语义分割方法,提供更丰富的预测细节

基于DeepLab v3架构的卷积神经网络模型采用二进制图像分割方法,以像素级精度进行癌症检测。

模型训练过程中,数字病理切片及相应的注释以20倍的放大率被分割为320*320的像素块,随后被输入到模型中。

据悉,像素块被输入模型时没有特定的方向,模型会对输入的病理切片进行90、180、270度的随机旋转和反转,使其保持相同的方向。

为了提高模型在判断来自不同医院、不同扫描设备的数字病理切片时的稳健性,研究人员还对像素块进行进一步处理:对像素块进行高斯模糊、运动模糊、颜色值抖动(亮度由0.0调为0.2,饱和度由0.0调为0.25,对比度由0.0调为0.2,色度由0.0调为0.04)。

在模型“诊断”像素块的过程中,像素级的预测结果是通过排序所有像素级预测的概率得到的。模型采用频率最高的1000个预测结果,并用平均值表示对病理切片的预测。

根据论文,相比于常用的图像块分类(patch classification)和滑动窗口( sliding windows),模型采用的方法在像素级上提供了更多预测细节。

三、运行:敏感性达到0.996,平均特异性达到0.806

模型训练完毕后,研究人员将其部署在中国人民解放军总医院中,进行为期3个月的试运行(2017年6月~8月)。训练期间,模型共对来自1814名患者的3212个日常胃部病理切片进行诊断。

据了解,1814名患者中有1101名男性,平均年龄为54.12岁;有713名女性,平均年龄为54.66岁。3212个日常胃部病理切片中,有154个外科标本数字病理切片,1660个活体组织数字病理切片。

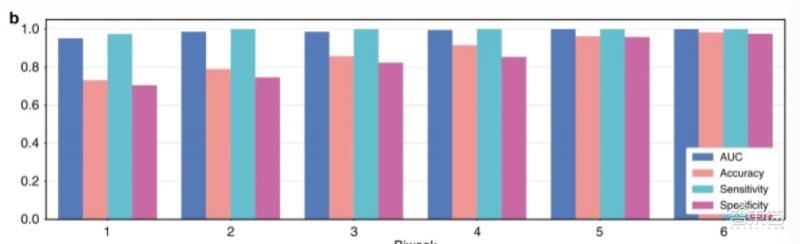

模型试运行过程中,胃部病理切片按照每两周为一时间段分组,三个月内共有6个连续的时间段。为了测试模型对不同扫描仪处理的病理切片的处理性能,研究人员将获得的病理切片在三个扫描仪上进行处理,得到一个数据集。

试运行结果显示,模型的曲线下面积达到了0.986,其准确性达到0.873、敏感性达到0.996、特异性达到0.843,标准差为0.018。

在机器学习中,敏感性又称真阳性率,即AI模型对疾病的敏感程度,敏感性越高,漏诊概率越低;特异性又称真阴性率,即AI模型判断出良性患者或健康人的能力,特异性越高,确诊概率越高。

文章插图

▲模型在不同时间段的试运行结果

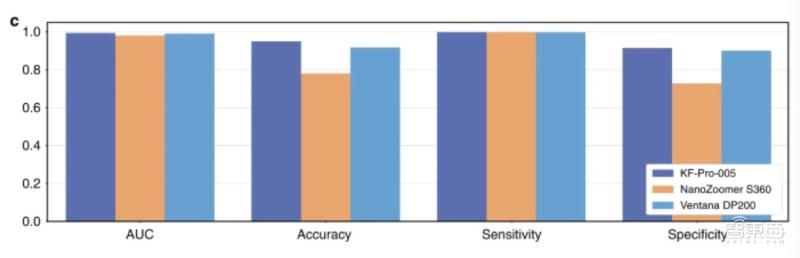

研究人员比较了模型对三台不同扫描仪产生的病理切片的预测结果,结果显示,模型对训练时使用的KFBio KF-PRO-005扫描仪产生的病理切片预测结果最为准确,对另外两台数字扫描仪产生的病理切片的预测效果准确性略有下降。

具体来说,模型预测Ventana DP200扫描仪产生的数字病理切片时,曲线下面积为0.004;预测Hamamatsu NanoZoomer S360扫描仪产生的数字病理切片时,曲线下面积为0.013。

针对三台不同扫描仪产生的共3212张病理切片,模型预测结果的敏感性达到0.996,平均特异性为0.806。

文章插图

▲模型对不同来源数字病理切片的预测结果对比

四、AI模型帮助病理学家提升预测准确度

为了测试AI模型能否在真实情况下作出准确判断,研究人员准备了100张数字病理切片,并对12名病理学家进行分组,以比较病理学家在借助AI辅助系统、不借助AI辅助系统下的诊断结果。

研究人员根据诊断难易程度,将数字病理切片分为四组,分别是:1、低倍镜下容易诊断组(含有34张病理切片);2、易于诊断但需要高倍率放大组(含有39张病理切片);3、难以诊断但不需要借助IHC组(含有23张病理切片);4、十分难以诊断,需借助IHC组(含有4张病理切片)。IHC指免疫组织化学染色法,是一种利用免疫学反应,监测细胞或组织中是否存在目标抗原的方法。

12位病理学家被分为3组,其中A组使用传统方式,用显微镜观测玻璃病理切片;B组直接观察数字病理切片;C组使用数字病理切片和AI辅助诊断系统。

测试进行两次,其中一次不限制诊断时间,另一次把诊断时间限制在1小时内。

在不限制诊断时间的情况下(图b),研究人员用ROC曲线比较病理学家的预测结果和AI模型的平均预测表现(模型的平均预测表现用图中“★”表示,即敏感性为0.996、平均特异性为0.806)。结果显示,AI模型和人类病理学家的表现相当。在一些情况下,AI模型的平均表现超过了人类病理学家。

- 诊断性|4000字精华解读,企业如何做好销售分析?

- 黑色星期五|感悟身临其境的魅力,TCL C12让一家人化身语言大师

- 域名|DAS - 你在 Web 3.0 的去中心化身份

- 召回|罗氏诊断公司主动召回肌红蛋白检测试剂盒(免疫比浊法)

- 小米科技|从3999跳水到2599,小米11彻底“化身”中端机,你入手了吗?

- 人造肉|华硕揭晓VivoWatch 5,强化身体数据量测、待机使用时间长达14天

- 艺术|你的宠物也有艺术化身了,谷歌AI新功能上线

- 筛查|融资丨「兰丁股份」完成阿里健康领投3.2亿元D轮融资,全力打造世界人工智能病理筛查诊断云平台

- 战略合作框架协议|昌红科技:与罗氏诊断在进博会上签订战略合作框架协议

- |小米化身驯龙大师,自研最强散热技术公布,骁龙898或彻底解封