梯度直方图(HOG)用于图像多分类和图像推荐( 三 )

一些建议!

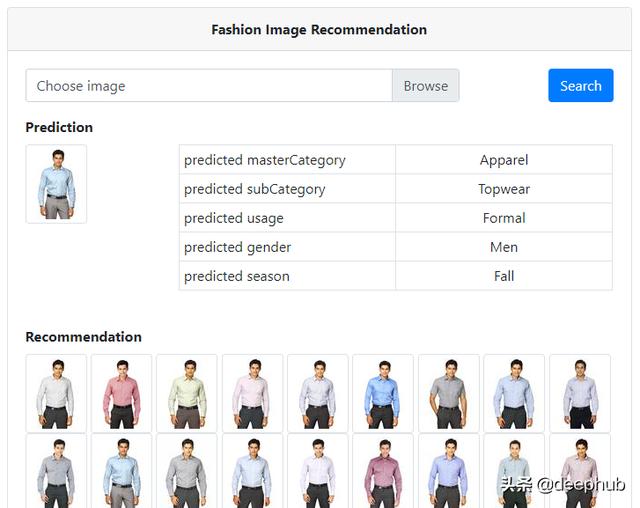

scaler_global = MinMaxScaler()final_features_scaled = scaler_global.fit_transform(hog_features)neighbors = NearestNeighbors(n_neighbors=20, algorithm='brute')neighbors.fit(final_features_scaled)distance,potential = neighbors.kneighbors(scaler_global.transform(hog_features_test))print("Potential Neighbors Found!")neighbors = []for i in potential[0]:neighbors.append(i)recommendation_list = list(df_labels.iloc[neighbors]['id'])recommendation_list使用Flask分类值和推荐图像构建了一个简单的webservice (UI的开发不在本文讨论范围之内) 。 webservice看起来如下所示: 文章插图

文章插图

结论本文首先说明了HOG背后的原理是什么 , 以及我们如何使用它来描述图像的特征 。 接下来 , 计算HOG特征并将其用于KNN分类器中 , 然后寻找K个最近邻点 。 这两个案例都在不使用任何深度学习方法的情况下达到了较高的准确率 。 在一些情况下 , 图像被错误地标记 , 或者图像有多个对象但被标记在一个类中 , 这会影响我们的模型 。 下一步是确定错误分类的根本原因 , 并制作一个更好的分类和推荐引擎 。

作者:Anirban Malick

本文代码:github/anirbanmalick/ComputerVision/tree/kaggle_classification

【梯度直方图(HOG)用于图像多分类和图像推荐】deephub翻译组:孟翔杰

- 王伟华|梯度科技董事长王伟华受邀出席中国-东盟青年领袖论坛

- 损失函数|可视化深入理解损失函数与梯度下降 | 技术头条

- 手推公式:LSTM单元梯度的详细的数学推导

- 实战PyQt5: 117-梯度渐变效果QGradient

- 梯度下降算法在机器学习中的工作原理

- OpenCV-Python 直方图-2:直方图均衡 | 二十七

- 偏导数和函数的梯度

- 王者荣耀|王者荣耀:法师梯度榜更新,T3变成甄姬与她?“天秀”的她成最后赢家!

- 王者荣耀|法师梯度榜突然更新,小乔甄姬沦为T3,玩不懂的她却再无克星

- 王者荣耀|世冠赛射手梯度榜更新!公孙离沦为T3,曾经的版本之子却重回T0