数机|【泡泡图灵智库】利用双目相机数机数据进行实时动态障碍物检测和跟踪( 二 )

2.3 聚类和3D跟踪

1)聚类:DBSCAN;

2)3D跟踪:首先,在时间t,我们将全局框架中所有当前群集的质心计算为其所有点的平均值。然后,我们将它们关联到最接近的质心,将群集关联到前一帧。

2.4 分类为静态和动态

根据投票策略,确定的聚类分为静态或动态:

1)对单个点的投票

2)从投票中排除要点

首先,如果机器人的视场(FOV)在两个帧之间改变,则点可能会出现在当前FOV的区域中,该区域与先前的FOV不重叠。由于我们仅观察到这些点云一次,将它们排除在投票之外。

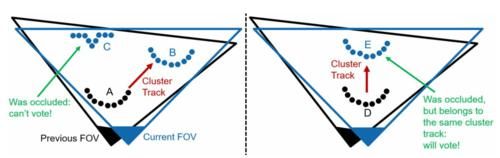

其次,如果当前聚类的点先前被其他对象遮挡,则我们将其排除在投票之外。具体来说,我们区分了这种遮挡和当物体从相机移开时发生的自遮挡,如图4所示。

文章插图

图4 动态物体检测时的遮挡处理

左:由于当前聚类C在上一帧中被聚类A遮挡,因此聚类C被排除在投票范围之外,而聚类A属于另一个群集;

右:没有将当前聚类E排除在表决范围之外,因为在前一帧中它被属于同一聚类D所遮挡。

2.5 2D人物检测

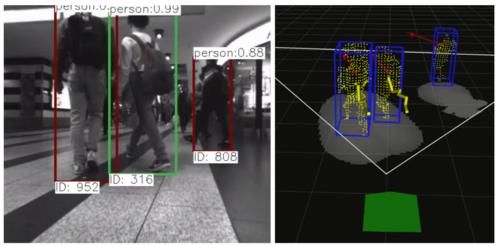

系统会将站立的人分类为静态,并且只有在她开始走路时才意识到它是动态的对象。通过将Mobilenet-SSD作为可视的2D人检测器添加到我们的pipeline中,我们实现了对行人的运动独立检测。我们选择此网络是因为它在灰度图像的运行时间和性能之间提供了适当的权衡。

文章插图

图5 左:Mobilenet-SSD人检测器的示例输出。每次检测均通过置信度进行评分,显示在顶部。我们为在图像平面上跟踪的每个边界框分配一个ID;

右:我们将检测结果与聚类相关联,蓝色长方体表示。

主要结果

文章插图

图6 我们评估中使用的样本图像以及用于收集它们的平台。我们的系统依靠安装在前面的双目相机,而LiDAR仅用于评估目的。

文章插图

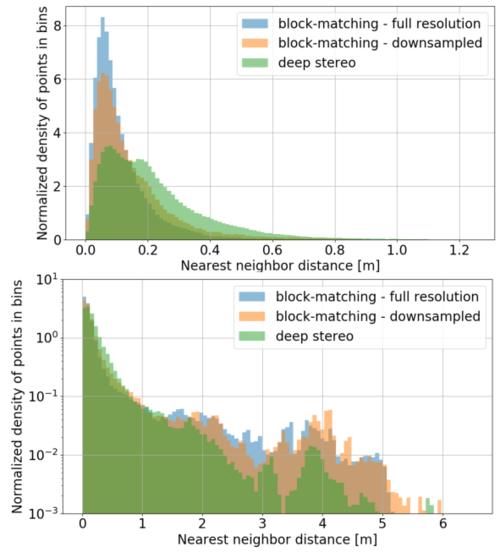

图7 来自LiDAR和双目相机的点云之间的最近邻居距离d的标准化直方图,以分析准确性和完整性。

上图/精度:d从相机到LiDAR的测量值。

下图/完整性:d从LiDAR到相机的距离。精度极限lc = 0.8m上方的区域表示立体摄像机点云未捕获的对象点。

相关资源

视频:https://youtu.be/AYjgeaQR8uQ

【 数机|【泡泡图灵智库】利用双目相机数机数据进行实时动态障碍物检测和跟踪】如果你对本文感兴趣,想要下载完整文章进行阅读,可以关注【泡泡机器人SLAM】公众号。

- 健身房|乐刻韩伟:产业互联网中只做单环节很难让数据发挥大作用

- 三个目标之后|品味莲乡 | 品味

- 星期一|亚马逊:黑五与网络星期一期间 第三方卖家销售额达到48亿美元

- 建设|龙元建设中标中国移动宁波信息通信产业园二期施工项目

- 优化|微软亚洲研究院发布开源平台“群策 MARO” 用于多智能体资源调度优化

- 获近|小影科技获近4亿元融资

- 联盟|天津半导体集成电路人才联盟成立

- 快递|国家邮政局:推动邮政快递行业由劳动密集型向知识密集型发展

- 发展|大数据解读世界互联网大会·互联网发展论坛!

- 数字化|国产替代势在必行,本土CRM如何破圈?