深度解析神经网络中每个神经元的使命 | MIT朱俊彦&港中文周博磊力作( 四 )

文章插图

文章插图

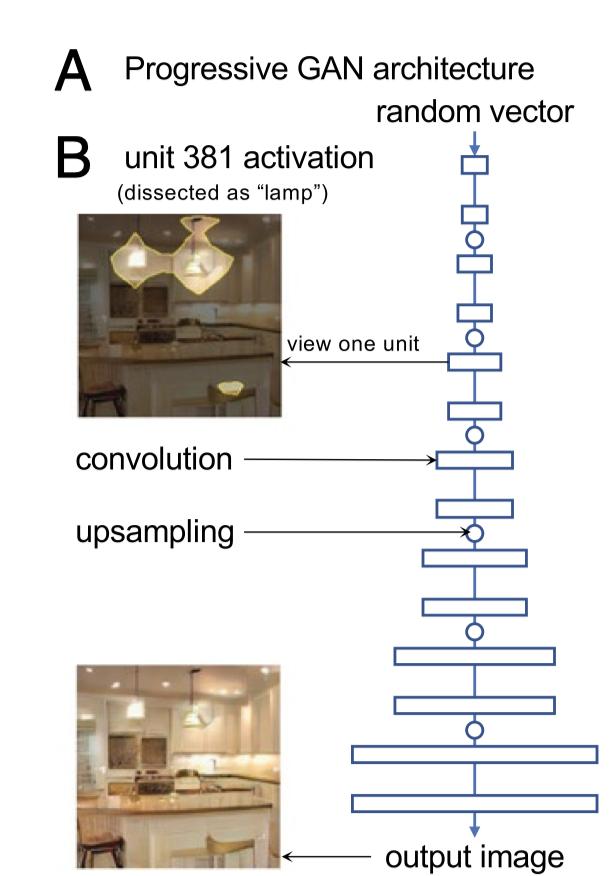

很重要的事 , 生成器中的逻辑流和分类器是相反的:当单元381激活图像中的吊灯区域的时候 , 它其实并没有检测图像里的吊灯 , 因为这一过程是在图像生成之前就出现的 , 相反 , 这个单元是渲染吊灯物体的计算过程中的一部分 。

为了定义在网络里和物体类别单元的位置 , 研究人员将网络解构应用于网络中的每一层 。 在实验中 , 参考的分割模型和阈值和用来分析VGG-16分类器的相同 。

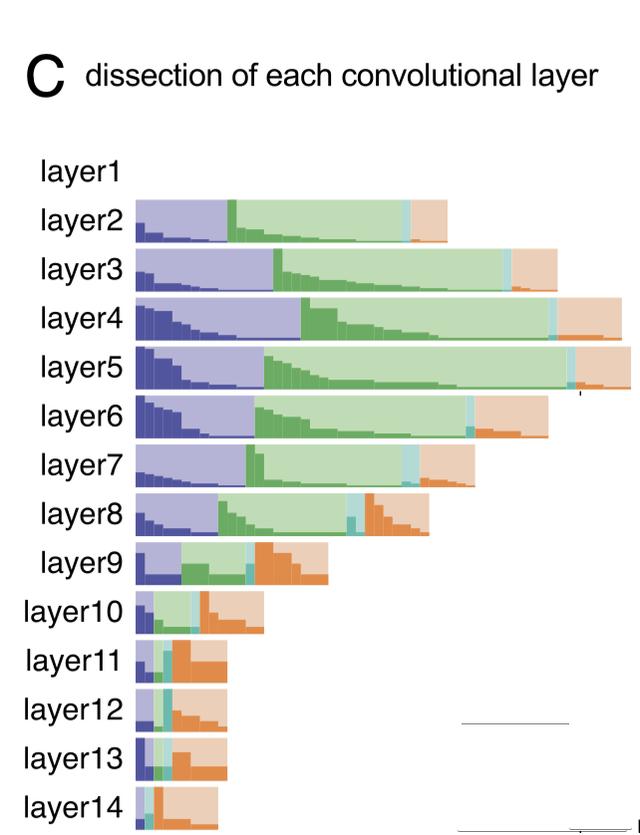

然而 , 和分析和输入数据中对象之间关系不同的是 , 研究人员分析了和输出图像中的物体之间的关系 , 如下图所示:概念单元数目的极值的出现并没有像在分类器那样出现在网络的边缘——它出现在中间层——第五层具有最大数量的物体和部分类别 。 文章插图

文章插图

下图展示了每个对象 , 物体部分 , 材质和颜色在第五层中和单元的对应关系 , 其中IoU>4%, 和分类网络相似的事 , 比如“烤箱”和“椅子”之类的视觉概念和许多单元对应 。 而和分类器不同的是 , 对应于某些单元的物体部分种类大于整个物体的种类: 文章插图

文章插图

上图显示了 , 神经单元并没有严格的对应于某种模式 , 而是展示了广泛的视觉多样性 , 以至于与每个类对应的外形模式都不同:比如对应于烤箱的不同款式或者颜色 , 抑或是厨具的形状 。

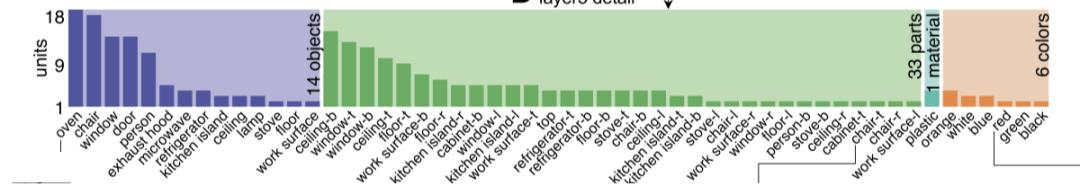

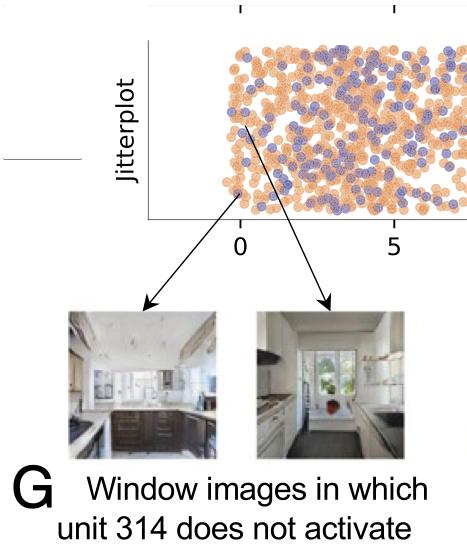

接下来 , 研究人员将对应于窗户的单元314作为图像分类器 , 结果发现在大窗户被生成与没有大窗户生成时候这一单元的活跃度的巨大差异 。 接着 , 仅仅一个简单的阈值(激活峰值>8.03%)即可令预测生成图像是否有大窗户这一任务具有78.2%的准确度: 文章插图

文章插图

然而 , 分布密度曲线显示了包含大窗户的图像在不激活单元314的情况下也能被频繁生成 , 下面是两个样本例子: 文章插图

文章插图

这些例子可以表明 , 其他单元也具有生成窗户的潜力 。

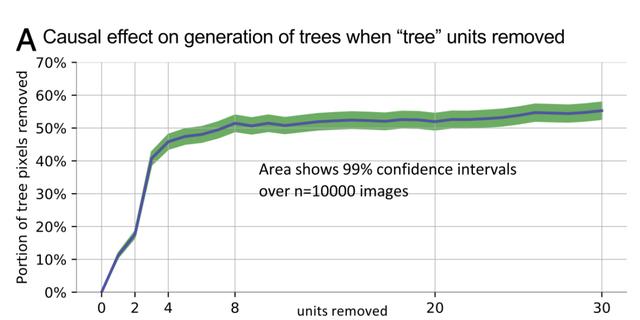

GAN中神经元的角色 神经单元和生成物体的类别之间的关联具有一定启发性 , 但是它并没有证明和某个物体类别相关的神经单元的确使得生成器去渲染了这些物体 。 为了更好的理解神经单元在GAN生成器中的逻辑角色 , 研究人员将直接移除或者激活某些神经单元的情况下 , 测试了生成器的输出结果 。

首先 , 研究人员连续将一部分代表树的单元从Progressive GAN中移除(此GAN是在LSUN教堂场景数据集中训练的) , 然后根据 文章插图

文章插图

将第四层的单元进行了排序 , 来定义和树最具有关联的单元 。

随着这些“树单元”的逐渐移除 , GAN的生成图像中树的含量和大小都在逐渐减小 。 一万个随机生成的图像显示 , 将20个和树关联最大的神经单元移除之后 , 生成输出中代表着树的单元数量减小了53.3%: 文章插图

文章插图

当“树单元”被移除的时候 , 生成图像的真实度几乎没有什么变化 , 虽然生成的树越来越少 , 个头也越来越小 , 其他的诸如建筑之类的物体并没有什么变化 。

显然 , 被树遮挡的建筑的一部分逐渐生成出来 , 就好像是移除的树暴露了它后面的墙和窗户一样 。 生成器看上去比原来计算出了更多的细节 , 而这些藏在树后面的建筑的细节只有在压制树的生成之后 , 才能被展现出来 。 文章插图

文章插图

这些隐藏的细节明显表明了GAN学习到的是图片的结构信息 , 而不是视觉像素模式的简单扁平总结 。

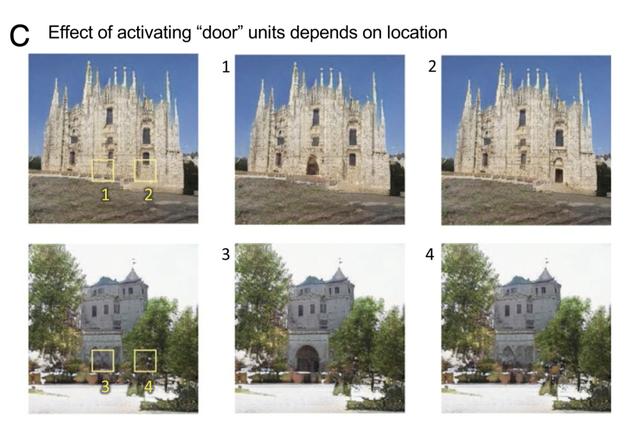

通过强制改变神经单元 , 研究人员发现可以将新的物体加入到生成场景中 。 在户外教堂GAN中 , 他们使用 文章插图

文章插图

找到了在第四层中和门最相关的神经单元 。

在测试的区域中 , 这20个单元的激活值都被强制设定为最高的 文章插图

文章插图

值 , 下图展示了在两个生成图像上的结果: 文章插图

文章插图

- 深度|iPhone12到底值得买吗 深度体验一周我发现了这些

- 高像素|加持高像素只为解析力?vivo S7丛林秘境展对样张细节的要求更严苛

- 采用|iPhone12mini和iPhone7深度对比:值得升级吗

- 设计|未来创意拒绝被垄断:欧拉共创成果深度解读!

- X50|vivo X50 Pro+深度测评:全能影像机皇登场

- 广度|华住创始人季琦:深度重要于广度

- 用于|用于半监督学习的图随机神经网络

- NeurIPS 2020论文分享第一期|深度图高斯过程 | 深度图

- 能力|美国研发快速法评估神经网络的不确定性 改进自动驾驶车决策能力

- iPhone12 mini|从华为P30换成iPhone12mini,深度体验一周,优缺点很明显