算法的设计逻辑是以无限满足人性偏好为标准,当然也包括人性的各种阴暗面都被激活并满足。与此同时,对于一些真正有价值的内容,会被彻底淹没。好比,大街上有位哲学家在演讲,旁边有两个女人在打架,你更愿意去看哪个?

算法实际上垄断了数据的收集和构建方式,以海量的信息构建一个框架,引领和影响众人的决策以及偏好。这种力量如果不加规范,没有任何约束,后果堪忧。如果有一天算法被利用,一而再,再而三给人们推送虚假的信息,那些被算法捆绑的用户,是否能分辨、从而摆脱算法呢?

事实上,这种任由智能推荐发展起来的互联网理想国,我认为急需得当的人为干预,而这种干预要能代表社会的正向价值观。此外,为了避免极端的马太效应,热门的内容越来越热门,冷门的内容越来越冷门。还需有效机制,让分发的内容避免趋同的前提下,带有正向价值观的偏见。

文章插图

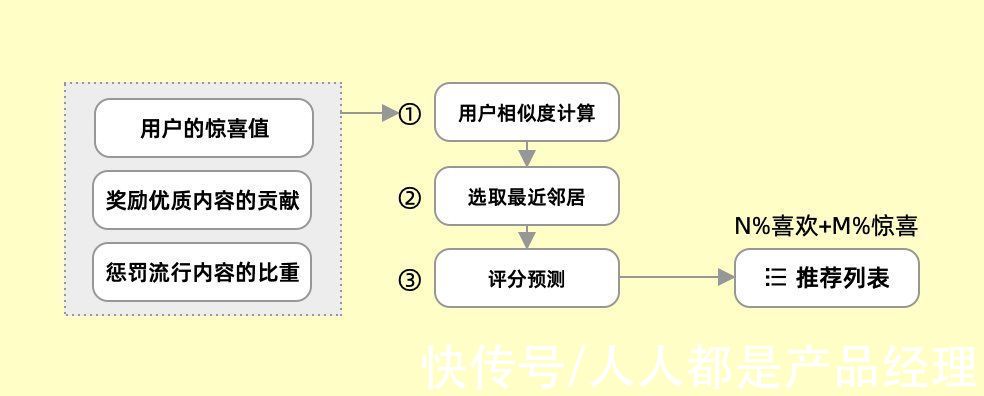

推荐-惊喜机制

对于用户而言,就算再喜欢某些内容,也不会只喜欢这类型内容。对于产品推荐的内容,需要在用户喜欢的基础之上,借助人为干预超越已知期望探索「惊喜」。

在协同过滤个性化推荐产生推荐列表的机制下,由于用户评分矩阵极端稀疏等原因,有学者提出了一种基于惊喜度的协同过滤改进算法,算法对于用户的惊喜值、奖励优质项目的贡献、惩罚流行项目的比重,对相似度计算公式进行改进,生成更加合理的邻居用户集,充分权衡推荐内容的惊喜度与准确度。

三、信息茧房的微光最早在2001年,哈佛大学Cass Sunstein教授在《信息乌托邦-众人如何生产知识》一书中提出,人类社会存在一种“信息茧房”现象。他认为在信息爆炸的互联网时代,人们更倾向于只接受自己感兴趣的信息,长期的信息偏食无异于作茧自缚,久而久之接触的信息就越来越局限,人就像被桎梏在“信息茧房”内,失去对其他不同事物的了解能力和接触机会。

在这个时代看似每个人都可以随意获取信息,事实上却是一个信息牢笼,你以为你想看到的,是别人刻意给你看到的。以为什么都能看见,却越什么都看不见。

文章插图

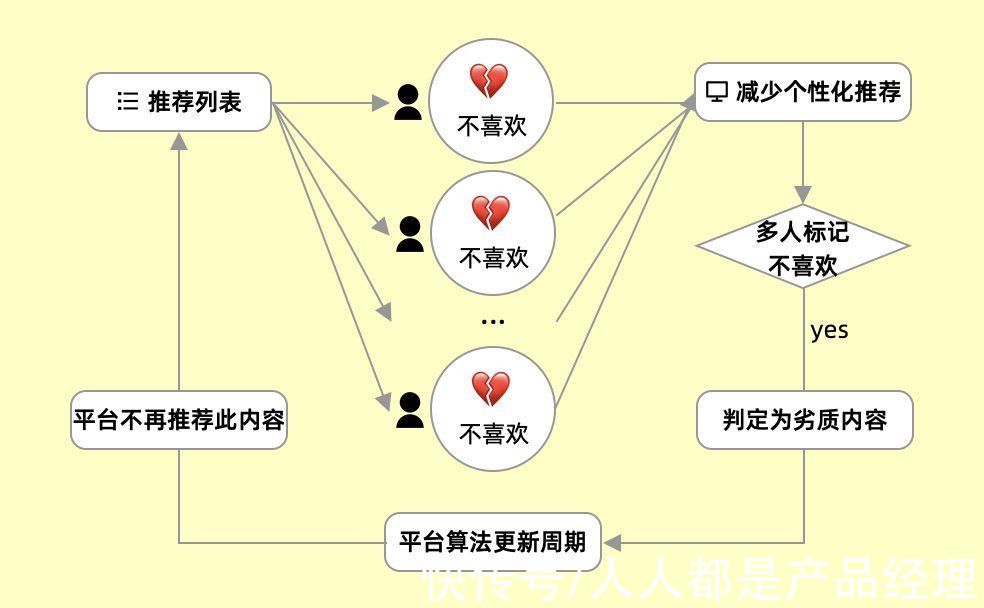

负反馈的连锁反应

在前面讨论智能推荐的信息分发,让用户只看到他想看的内容。对于「不喜欢」的内容,系统会根据用户的喜好,减少个性化的推荐,甚至不推荐。「不喜欢」一般来说在算法中的影响是局部的,受到影响的只是单个用户。但了解过推荐系统智能推荐背后“近邻”的逻辑后,你还会认为你的「不喜欢」只是个人行为吗?

对于推荐列表的内容,面对单个用户标记「不喜欢」,并不会对内容的展现有太多的影响。但是多个用户都标记了呢,事实上,在这样的情况下,系统会自动判定为“劣质内容”,在平台算法周期性更新后,此内容将永远不会获得系统的推荐,也就是永远被淹没在信息的海洋。

一开始,我也认为这样的逻辑并无不合理之处。直到有一天坐车,我在汽车电台听到这样一个故事,让我陷入了反思。

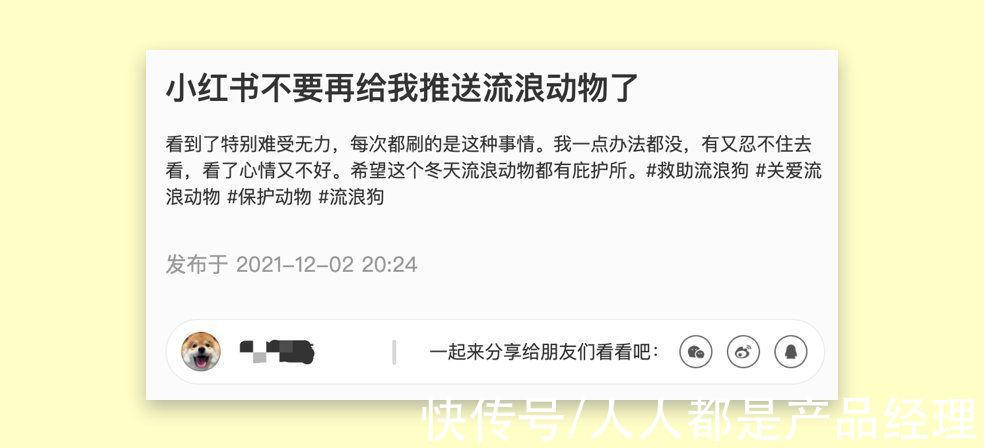

文章插图

用户反馈| 截取小红书

事情是这样的,一位非常喜欢动物的小红书用户,平时会比较关注流浪动物的信息。久而久之,每当这位用户打开小红书,feed流全是这样的信息。这让他非常难过,看到这么多的流浪动物被弃养,无家可归,经常看到这类信息,自己却无能为力。

迫于无奈,发出了「小红书不要再给我推送流浪动物」的动态。如果依据之前的逻辑,这些需要被救助的流浪动物的信息,就是被系统当成「劣质内容」,悄无声息地被淹没,这是一件多么不幸的事啊。

这是被算法支配的世界,系统只会奖励人们想看到的内容。如果大家都点击不喜欢,那么流浪动物的信息能被看到的概率就更小了。

文章插图

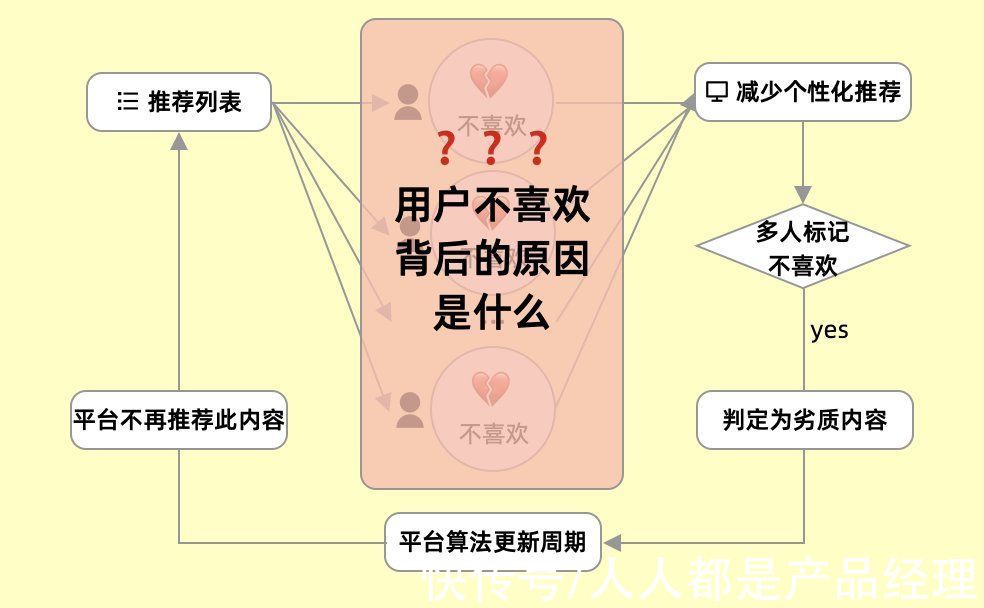

负反馈的背后的秘密

对于算法,它秉持的绝对理性或许并不能完成理解用户「喜欢」与「不喜欢」背后的意涵。或许算法需要进步,我们在已然存在的信息茧房中,或许也可以凭借自身的能力做些什么。总不能干等着技术自己去意识问题,自我改善吧。

我在想,是不是下次我面对这样的情况下,点上一个赞,分享转发,评论,又或者在系统多轮多次推荐类似内容的时候,主动告知平台运营团队「不喜欢」背后的深意,即便是微光。

- 你在过年,他们在TikTok赚老外的钱

- 小米科技|新手机千万别瞎买,3000元价位就选这三款,看看有你在用的吗?

- 流浪狗|偏门项目,一月收入四五万

- 野生动物|谷歌开放.day域名的注册 涉及公益组织等22个领域

- 黑白电视机|几乎无短板的千元机,目前这三款表现最好,看看有你在用的吗?

- 淘宝|阿里测试办公平台“翱咔”,阿里“动物园”迎来新成员?

- 聚会|2021烂大街的3款手机,第一款过年聚会大概率见到,你在用哪款?

- 华为|miui8开发版会卡顿,更新以后有点卡,如果你在乎卡顿可以用稳定版

- 闲鱼|你在跨年时,这群90后在闲鱼“断舍离”

- 壁纸|Win11更新“个性化”版本:带你在桌面上看世界、使用语音访问PC