文章插图

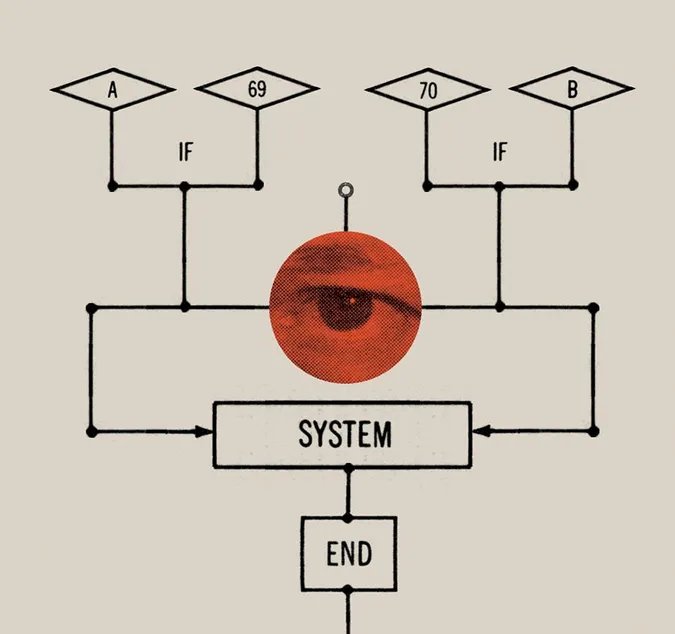

设想这样一个场景:AI已经拥有完美生成的能力,利用先进的机器学习工具生成的图像、视频、音频和文本已经“以假乱真”。但如果决策者陷入假信息旋涡,并做出决断,不可避免会导致危机。当上升到国家高度,甚至会发动战争。乔治敦大学的研究员安德鲁?罗恩(Andrew Lohn)认为:AI已经能够产生大量以假乱真的信息。而且AI的特点是“随着大量信息的生成,系统会不断与真实信息进行对比,并且升级生成能力”。

AI信息生成技术也被称为“DeepFake”,其带来的恶作剧已经造成了某些影响。例如去年5月份,一些欧洲高级议员收到了一些“俄罗斯反对派人物”的视频会议邀请,还煞有其事地讨论了克里米亚问题之类的政治事务,结果发现在这些所谓的“俄罗斯反对派人物”都是别人用Deepfake换脸假冒的。这些受骗者包括拉脱维亚议会外交事务委员会主席Rihards Kols,以及来自爱沙尼亚和立陶宛的议员……

首先,是“质量”问题。例如黑客会利用系统中微小的缺陷。乔治敦大学的海伦·托纳(Helen Toner)表明:“从一个无伤大雅单点故障开始,然后所有通信失灵,人们恐慌,经济活动陷入停滞;随后持续的信息缺乏,再加上其他错误计算,可能导致局势失控。”

另一方面,瑞典的斯德哥尔摩国际和平研究所高级研究员文森特?布拉南警告可能发生重大灾难:“大国为了赢得先发制人的优势而‘偷工减料’,如果一个国家将开发速度置于安全、测试或人为监督之上,那么这将是一场危险的竞逐。”例如,为了获得速度优势,国家安全领导人可能会倾向于授权指挥和控制决策,取消黑盒机器学习模型的人为监督。想象一下,如果自动发射导弹防御系统处于无人监督的环境下会发生什么?

随着面部识别、生物识别、基因组数据分析等技术兴起。安德鲁?罗恩担心:“我们有时候并没有意识到大数据跟踪和监视技术的不断发展,会使我们进入了未知的危险领域。”数据一旦被收集和分析,其作用就会远远超出跟踪和监视的功能,例如AI的预测性控制功能。今天,AI系统可以预测我们将购买哪些产品,我们将观看哪些娱乐节目,以及我们将点击哪些链接。当这些平台比我们自己更了解我们时,我们可能不会注意到这种微小的变化,但它剥夺了我们的自由意志并使我们受到外部力量的控制。

文章插图

- 阿里巴巴|继当选IEEE Fellow之后,阿里云李飞飞又新晋ACM Fellow

- 浙江大学|IEEE正式推行首个隐私保护机器学习国际标准 蚂蚁集团参与制定

- 大数据|IEEE Fellow李世鹏 :人工智能与机器人前沿研究之思考

- G论智三易,串联通讯,贯通边缘,演进认知,汇于机器:听五位IEEE Fellow畅谈 gai

- 领域|IEEE Fellow梅涛:视觉计算的前沿进展与挑战