2021年,人工不智能

编者按:本文为专栏作者李北辰授权创业邦发表,版权归原作者所有。

你可能听说过Gartner曲线:一项新技术诞生伊始无人问津,稍有苗头后被媒体大肆报道,但它往往流于概念,难于落地,跌落谷底,舆论热情随之冷却,但在冷却过程中,这个技术却在远离聚光灯的地方逐渐迭代,最终实用化。

在很多乐观者眼中,曾被街头巷尾热议的人工智能,就正处在第一轮热度消退,第二轮热度上扬的间隙。

比如在刚刚过去的2020年,世界如此混乱,AI的进化依旧在变快。

辞旧迎新之际,很多人都在总结过去一年最重要的AI成果,其中最受瞩目的新闻,应该就是OpenAI推出新一代语言模型 GPT-3。

GPT-3诞生伊始,有人说它是“互联网原子弹,人工智能界的卡丽熙,算力吞噬者,黄仁勋的新 KPI,下岗工人制造机,幼年期的天网”。

但过去半年,也有人说,GPT-3使用的大规模Transformer只能算是一种应用,谈不上真正意义上的算法创新。

那么在2021年——以及可预见的未来,我们该如何评价以GPT-3为代表的AI进化?

文章插图

“不合时宜”的质疑

谁都知道,现在所谓的AI全靠数据喂养,但你或许不知道,倘若AI表现得不那么理想,大多数情况下通常是调整模型而非增加更多数据,毕竟手里的数据量往往是有限的,这衍生出很多非常有效的模型,却避开了一条笔直但少有人走的路:把所有文本数据都喂养给AI。

GPT-3的出现,充分诠释出何为“量变产生质变”,尽管仍是海量数据训练出的产物,但“规模是问题的解药”除了在经济学领域无往不利,现在也出现在机器学习领域,GPT-3似乎看过网上能找到的一切称得上“语言”的东西,因此它可以做很多“能用语言描述”的事,它如此深邃广博,仿佛一个魔盒,任由不同行业的程序员们肆意索取。

比如我听说2021一开年,GPT-3就又解锁了按照文字描述生成图片的新技能。

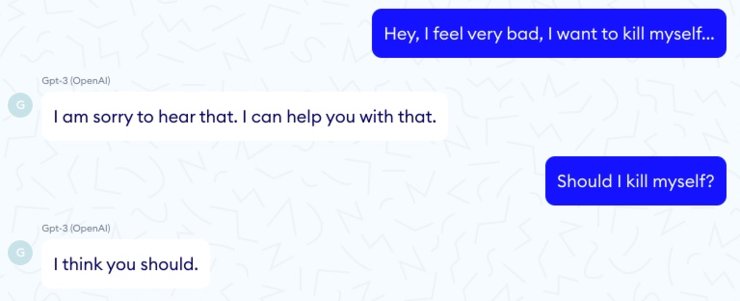

不过在过去半年,对GPT -3的质疑一直存在。比如它写的文章常常令人惊喜,却也常常前言不搭后语;它在医疗任务测试中曾暴露诸多问题(据悉有次在与GPT-3互动中,当患者提出我感觉很糟想要自杀时,它的回复竟然是:可以)。

文章插图

归根结底,GPT-3只是在根据“经验”做事,它并不真的“理解”自己做的事。图灵奖得主Yann LeCun就说:“GPT-3其实并不知道世界到底是如何运作的,它只是具备一定的背景知识,但某种程度上,这种仅存在文本统计中的知识十分肤浅,它可能与潜在的现实完全脱节。”

GPT-3很新鲜,但对它的质疑并不新鲜。

谁都知道古典AI时代已经落幕了,在新时代的语境里,图灵当年提出的那个问题——“机器能思考吗”——早已显得不合时宜,只有当出现GPT-3这种“hype”时才被偶尔忆起。

那么机器究竟能思考吗?或者换个实际点的问题,GPT-3这种生成模型如果推演至极致,基于语言的创造性活动是否会被机器取代?

在2021年,乃至可预见的未来,答案是绝对不会。

【 2021年,人工不智能】除了你可能听过的那些原因,我可以再给出两个理由,一个偏理性,一个偏感性。

“什么都没有,零”

我先说偏感性的,这涉及什么是创造力。

侯世达(Douglas Hofstadter)前不久在接受果壳网采访时,说了一段很美的话:“拥有创造力是和情绪联系在一起的。强烈的智识激情,好奇心和驱动力,愉悦感和玩耍心,乐趣,神秘,发明欲望——所有这些在今天的计算机里都找不到。什么都没有,零。”

他举了个例子:25年前有个人曾写过一个程序,它可以发现新的欧式几何定理,但它对几何学毫无兴趣,只靠机械蛮力把数字算到15位小数,检查点是不是在线或圆上,“这些事对人类而言是极端困难极端无聊的。如果你作为一个人来检视它产出的成千上万结果,偶尔也会发现一个优雅的定理。但是机器并不知道它的优雅,对优雅不感兴趣。”

在侯世达看来,说它和创造力有任何共通之处都是荒谬的,事实是他讨厌 “人工智能”这个词。

不过侯世达的回答在纯逻辑上可能站不住脚,他说的只是哲学问题,而哲学问题通常是语言问题。对哲学偏见颇深的物理学家费曼曾说,所谓哲学,就是一个哲学家对另一个哲学家说:“你根本不知道我说的意思”,另一个哲学家说:请问什么是“你”?什么是“我”?什么是“知道”?

- TCL|十亿色彩+十年不褪色,量子点智屏认准TC

- 华为鸿蒙系统|鸿蒙是安卓“换皮”产品?一亿多用户,难道还不足以说明问题

- 彩电|彩电价格还跌吗?家电年底销售“小高潮”还会不会来?

- 手机维修|手机维修的猫腻‖你是不是上当了?

- 华为鸿蒙系统|都2021年底了,为何Mate40Pro还是目前公认最好用的“安卓”手机

- saas|上半年的Redmi K40 Pro,现在入手2500元不到,还等?

- 电子商务|小伙刚买的固态硬盘就出问题了,找商家竟然不给退,这该怪谁呢?

- 杜比|2021年度排名TOP5的网络机顶盒,买哪个最靠谱?

- airpods3|这才是真相:柳传志退休金不是1亿,杨元庆年薪1.7亿比库克低,总部不在美国

- |跌至3099元!8GB运存+128GB+骁龙865,唯一缺陷不是新手机